- Início

- The Thinking Wire

- A Cloudflare Publicou o Próprio Estudo de Caso

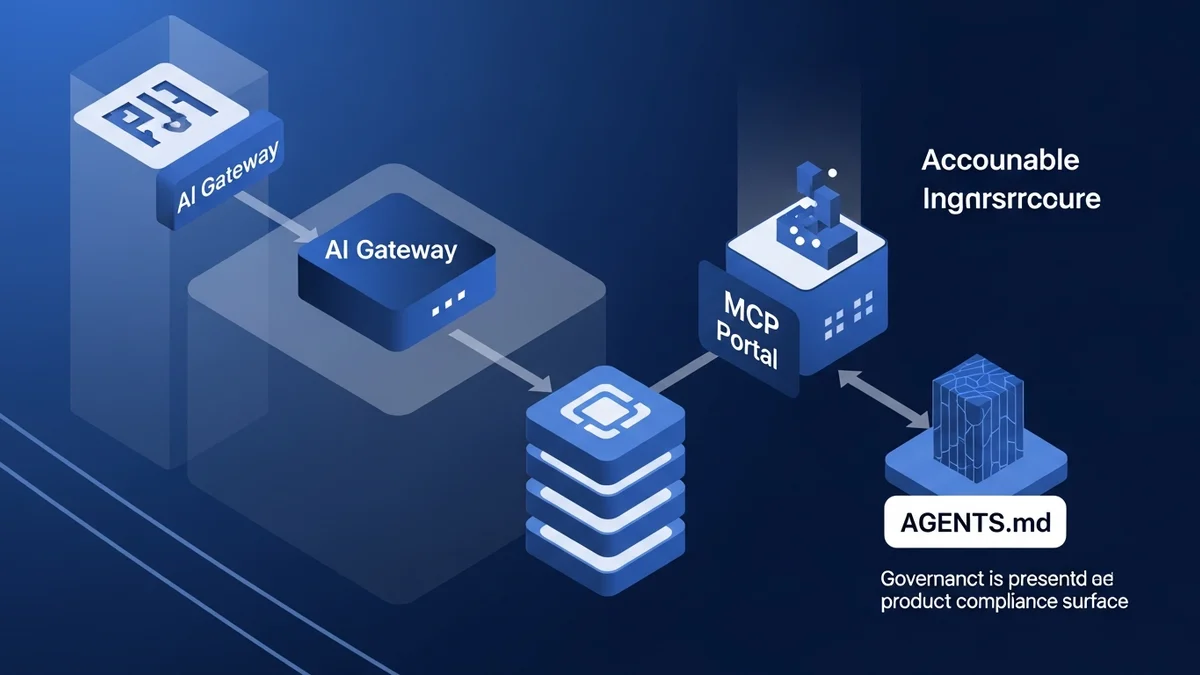

No dia 20 de abril, a Cloudflare publicou um post chamado “A pilha de engenharia de IA que construímos internamente, sobre a plataforma que vendemos”. Três engenheiros do time de Developer Productivity descrevem como o próprio R&D usa AI Gateway, acesso zero-trust, MCP Portal, AGENTS.md e um AI Code Reviewer para tocar o dia a dia da engenharia.

Tire a marca e sobra a arquitetura de referência que vimos descrevendo há um ano.

Quando argumentamos sobre os quatro lançamentos em uma semana, a tese era que a Cloudflare havia transformado governança de agentes em taxonomia de produto: identidade, rede, custo, coordenação. Este post fecha o arco. O fornecedor que entrega a taxonomia agora opera sobre a taxonomia. Em público. Com números.

Vale a leitura. Também é peça de marketing, publicada três dias depois do encerramento da Agents Week 2026. Leia pelo padrão. Desconte o resultado pelo incentivo óbvio. Sobra sinal suficiente para importar.

O que é de fato novo

Os produtos de governança da Cloudflare não são novidade. O dado de adoção é. Cinco números se destacam, e só fazem sentido numa ordem específica.

Adoção primeiro. A Cloudflare reporta 3.683 usuários internos de ferramentas de IA para código numa janela de 30 dias. Isso são 60% da empresa e 93% do R&D. Os 93% estão direcionalmente acima da linha de base da Stack Overflow 2025, que fica em torno de 84% — é acima, não é inédito. É também medido como “usou pelo menos uma vez em 30 dias”, com o denominador do R&D não divulgado. O número interessante não é 93%. O interessante é que uma organização de ~6.100 pessoas tem quase quatro mil engenheiros roteando toda requisição de IA por um único plano de controle.

Throughput em segundo. Os merge requests saíram de ~5.600 por semana para ~8.700, com pico de 10.952 na semana de 23 de março. O post enquadra isso como ganho de velocidade. É em parte ganho de headcount, já que a Cloudflare cresceu cerca de 20% no ano, e em parte ganho de PR menor. Ninguém no post divulga tamanho de PR, taxa de revert ou taxa de escape de defeito. Throughput subiu. Produtividade não está provada. Trate o gap como tal.

Volume de review em terceiro. O AI Code Reviewer processou 5,47 milhões de requisições e 24,77 bilhões de tokens na mesma janela. Todo merge request passa por uma revisão automática antes de o humano ver. Este é o número que mais deveria importar. Também é o que chega sem dado de resultado. Sem taxa de aceitação. Sem taxa de falso positivo. Sem taxa de bug real encontrado. Volume conta que a máquina está rodando. Não conta que a máquina é útil.

Eficiência de contexto em quarto. O Code Mode da Cloudflare colapsou ~15.000 tokens de esquemas de ferramentas MCP para perto de zero por requisição, convertendo-os em APIs TypeScript executadas num sandbox. Boa engenharia, economia real, não invenção da Cloudflare. A Anthropic publicou o mesmo mecanismo em novembro de 2025, com redução de 150 mil para 2 mil tokens via descoberta de ferramentas por sistema de arquivos. A Cloudflare escalou o padrão. A Anthropic enquadrou primeiro.

Arquivos de contexto em quinto. AGENTS.md em cerca de 3.900 repositórios, gerados a partir de um grafo de conhecimento interno com 2.055 serviços, 375 times e 1.302 bancos de dados. Esse é o dado que antecipamos em Contexto Passivo Vence. A tese era que contexto passivo e sempre presente no repositório supera a invocação ativa de skills. A Cloudflare acaba de rodar esse padrão na escala de 3.900 repositórios. Nota importante: AGENTS.md é spec aberta sob tutela da Linux Foundation, com contribuições de OpenAI, Google, Cursor, Amp e Factory. A Cloudflare é adotante. A proeza aqui é throughput de geração, não autoria.

O que o post concede de forma silenciosa

Duas frases do post fazem mais trabalho do que o resto do ensaio. A primeira: “Um AGENTS.md desatualizado pode ser pior do que nenhum arquivo.” A segunda: a implícita, o que cada métrica ausente diz em voz alta.

A primeira frase transforma AGENTS.md de variante de README em artefato de controle versionado. Arquivos gerados envelhecem. Empresas que jogam o arquivo em 3.900 repositórios e se afastam vão produzir 3.900 superfícies de passivo, não 3.900 vitórias de governança. A resposta da Cloudflare é gerar o AGENTS.md a partir de um Engineering Codex que não pode ficar fora de sincronia. O arquivo é uma projeção da verdade do registro de serviços, não um documento escrito à mão. Este é o padrão que vale copiar. A contagem de arquivos não é.

A segunda concessão é o que não está no post. Nenhum custo por MR mergeado. Nenhuma taxa de escape de defeito. Nenhuma taxa de revert. Nenhuma taxa de incidente de segurança. Nenhum score de satisfação de desenvolvedor. Nenhuma taxa de aceitação para o reviewer. Nenhuma distribuição de obsolescência dos AGENTS.md. O estudo de caso evidencia adoção e arquitetura. Não evidencia resultados. São afirmações diferentes.

Por que ainda importa

Quando argumentamos que engenharia tem Cloudflare e marketing não tem nada, o ponto da capacidade era fácil e o ponto da adoção estava em aberto. Quantas organizações de engenharia estavam de fato roteando cada chamada de LLM por um gateway consciente de identidade? Quantas tinham um revisor de IA em cada PR? Quantas tinham contexto padronizado no nível do repositório? A resposta era, em boa parte, desconhecida. Os estudos de caso de referência eram privados.

A Cloudflare acaba de tornar um deles público. É autoelogio, mas é legível. O formato é: gateway mais catálogo mais portal mais reviewer mais arquivos de contexto, tudo atrás de SSO zero-trust, com telemetria de uso que justifica o investimento. É isso o padrão. Ele é portável. Dynamic Workers e Workers AI não são portáveis; isso é vendor lock-in. O padrão é.

A outra razão para ler: o “antfooding” da Anthropic, divulgado via Lenny’s Newsletter, aponta na mesma direção a partir de outra empresa. 67% a mais de PRs mergeados por engenheiro por dia. Cobertura de comentários de revisão passando de 16% para 54%. Os agentes autônomos de código da Stripe estão mergeando mais de 1.300 PRs por semana sob revisão humana. Três empresas, três arquiteturas, a mesma lição: infraestrutura precede velocidade de IA. O paradoxo de produtividade documentado pela Faros AI mostra o que acontece sem essa infraestrutura: +98% de PRs mergeados e +91% de tempo de revisão. O movimento da Cloudflare foi absorver o imposto do tempo de revisão com automação. Esse é o movimento que torna o número de adoção sustentável.

A leitura útil para quem não é Cloudflare

Se você é CIO numa empresa que não é plataforma e está lendo esse post como template, faça três ajustes.

Não persiga os 93%. Persiga o plano de controle. Governança é o ponto; o número de adoção vem depois. Uma empresa com gateway roteado e 60% de adoção está em posição melhor do que uma empresa com 93% de adoção e nenhum gateway.

Não trate velocidade de MR como métrica de sucesso. Trate-a como insumo para a pergunta de se a sua porteira de revisão consegue absorver a carga. O dado da Faros é a cara de “sem porteira de revisão”. Os 5,47 milhões de requisições da Cloudflare são a cara de “porteira de revisão escala”. O delta é o que você está comprando.

Não copie os produtos específicos. Copie a forma. Toda empresa precisa de um plano de controle com identidade para tráfego de IA, um registro de ferramentas, um portal que agrega servidores MCP, um passe de revisão automatizada com orçamento definido para falso positivo, e um arquivo de contexto por repositório gerado a partir de uma fonte de verdade que ele não consiga superar. A implementação da Cloudflare é uma instância. O padrão é o artefato.

É, em linhas gerais, para onde vimos apontando a Releezy. O Guardian é o placar equivalente ao AI Code Reviewer: toda mudança cita a regra que a governou. O Loop é a faixa de throughput com accountability, onde a velocidade de MR se preserva porque a revisão é automatizada, não pulada. O ponto não é o produto. O ponto é que a arquitetura tem nome agora, e tem um cliente público.

O resumo honesto

A Cloudflare publicou um estudo de caso escrito pelo fornecedor da pilha descrita, agendado para uma semana de lançamento. Toda métrica escolhida sobe. As que poderiam descer não estão no post. É assim que estudos de caso escritos pelo fornecedor funcionam, e é legítimo, desde que o leitor aplique o desconto óbvio.

O que sobra depois do desconto é o padrão. Uma grande empresa de infraestrutura opera sua engenharia sobre uma arquitetura documentada e multicamada de governança de IA, com telemetria provando que a arquitetura está em uso. “Vamos resolver governança de agentes depois” perdeu mais um trimestre de defensibilidade na segunda-feira. O padrão é público. O dado de adoção é público. O dado de resultado segue privado, e é essa a parte da conversa que os próximos doze meses terão de fechar.

Fontes

- Cloudflare Engineering. “Cloudflare’s internal AI engineering stack.” Abril 2026.

- Anthropic. “Code Execution with MCP.” Novembro 2025.

- Lenny’s Newsletter. “How Stripe and Anthropic ship code with AI.” 2026.

- Faros AI. “The AI Productivity Paradox.” 2025.

- Stack Overflow. “2025 Developer Survey — AI.” 2025.

Para desenhar a infraestrutura contábil de IA no seu time — o placar para humanos e agentes — fale com a Victorino: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa