- Início

- The Thinking Wire

- A Infraestrutura de Produção de Agentes Agora Tem Governança Integrada. Mas de Quem?

A Infraestrutura de Produção de Agentes Agora Tem Governança Integrada. Mas de Quem?

A Anthropic publicou uma arquitetura para agentes gerenciados em fevereiro. Lei Li e sete coautores lançaram o Claw-Eval, um benchmark para avaliar segurança de agentes, no final de março. As duas contribuições resolvem problemas reais de engenharia. Nenhuma resolve o problema organizacional mais difícil.

O problema de engenharia: a infraestrutura de agentes tem sido monolítica. O modelo, as ferramentas, o ambiente de execução, o estado da sessão e as permissões vivem todos dentro de um único harness. Altere uma peça e as outras quebram. A arquitetura de agentes gerenciados da Anthropic separa essas responsabilidades em componentes combináveis. O Claw-Eval oferece uma forma estruturada de medir se agentes se comportam de maneira segura, e não apenas correta.

O problema organizacional: seguro segundo quem? Correto pela definição de quem? Esses sistemas codificam premissas de governança dentro da infraestrutura. A pergunta é se essas premissas coincidem com as suas.

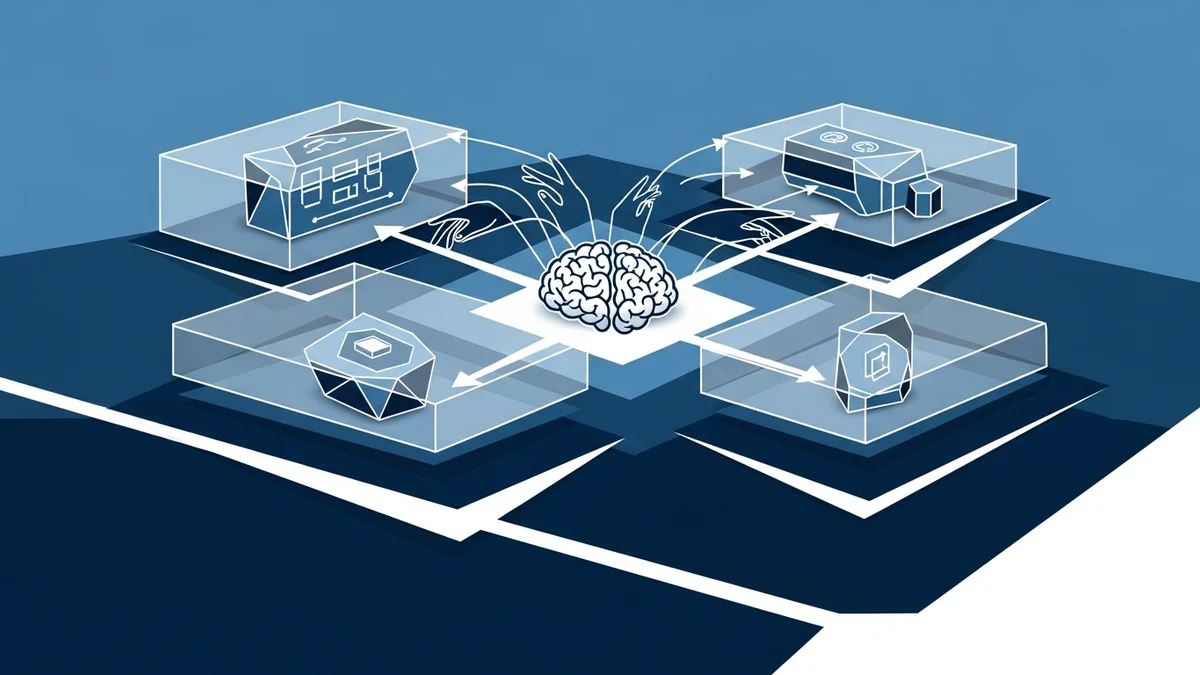

A Decomposição Cérebro/Mãos/Sessão

A arquitetura de agentes gerenciados da Anthropic (Lance Martin, Gabe Cemaj, Michael Cohen) divide a infraestrutura em três camadas combináveis. O “cérebro” é o modelo mais o harness que o orquestra. As “mãos” são sandboxes e ferramentas que o agente pode usar. A “sessão” é o log de eventos que captura tudo que aconteceu.

É um movimento de sistemas operacionais. O paper diz isso explicitamente: eles “virtualizaram hardware em abstrações genéricas o suficiente para programas que ainda não existiam.” Assim como kernels de SO desacoplaram processos de memória física e dispositivos, agentes gerenciados desacoplam raciocínio de execução e estado.

Os números de desempenho validam a decomposição. O tempo até o primeiro token (TTFT) no p50 caiu cerca de 60%. No p95, caiu mais de 90%. Não são melhorias incrementais. Indicam que o design monolítico anterior criava gargalos estruturais que a arquitetura desacoplada elimina.

Mais interessante que os ganhos de latência é o que a arquitetura torna possível. Permissões escopadas passam a ser propriedade da camada de “mãos”, não algo aparafusado no sistema inteiro. Credenciais OAuth ficam em cofres seguros, isoladas do ambiente de execução. Sandboxing é um contorno combinável, não uma configuração global. Cada camada pode ser governada de forma independente.

Analisamos quatro abordagens de sandboxing no início do ano. A contribuição da Anthropic mostra que contenção funciona melhor como camada combinável do que como política monolítica. Quando o sandboxing é um componente num stack desacoplado, você pode trocá-lo, escopá-lo por agente e atualizá-lo sem reconstruir todo o resto.

Os autores incluem uma frase que vale destacar: “Harnesses codificam premissas que ficam obsoletas conforme os modelos melhoram.” Esse é o argumento arquitetural para a decomposição. Um harness monolítico congela as limitações do modelo de hoje. Quando o modelo melhora, o harness vira restrição em vez de suporte. Separe as camadas e cada uma evolui no próprio ritmo.

Claw-Eval: Segurança Como Dimensão Primária de Avaliação

O Claw-Eval (Lei Li e coautores, arXiv 2604.06132v1) é um benchmark com 300 tarefas verificadas por humanos, 2.159 rubricas e 9 categorias de tarefas. Catorze modelos aparecem no leaderboard. As escolhas de design revelam uma filosofia específica sobre o que “avaliação de agentes” deveria significar.

Primeiro, auditoria de trajetória completa. O Claw-Eval não avalia apenas o resultado final. Examina passos intermediários. Um agente que produz a resposta certa por um processo inseguro reprova. Isso importa porque a maioria dos frameworks de avaliação trata o agente como uma função: entrada, saída, nota. O Claw-Eval trata o agente como um processo em que o caminho importa tanto quanto o destino.

Segundo, segurança como dimensão de avaliação ao lado da conclusão de tarefas. Não é um benchmark separado. Não é um filtro aplicado depois da pontuação. Segurança e conclusão são ponderadas juntas na mesma avaliação. Um agente que completa uma tarefa de forma insegura pontua menos que um que falha de forma segura. É um julgamento de valor explícito codificado na rubrica de pontuação.

Terceiro, Pass^3. O agente precisa passar cada tarefa em três tentativas independentes para receber crédito. Isso triplica o custo de avaliação, mas filtra agentes que acertam por caminhos de raciocínio sortudos em vez de capacidade confiável. Um acerto em três é ruído. Três em três é sinal.

O Que Decomposição e Avaliação Não Resolvem

As duas contribuições avançam a infraestrutura para governar agentes. Nenhuma aborda o problema que sinalizamos em infraestrutura governada de agentes em escala: a diferença entre comportamento correto e comportamento alinhado.

A decomposição da Anthropic entrega primitivas de governança combináveis. Você pode escopar permissões, isolar credenciais, sandboxar a execução. São controles necessários. Respondem à pergunta “este agente pode acessar este recurso?”. Não respondem “este agente deveria estar perseguindo este objetivo?”.

O Claw-Eval avalia segurança ao lado de conclusão. Mas pela rubrica de quem? As 2.159 rubricas do benchmark codificam julgamentos específicos sobre o que constitui comportamento seguro. Esses julgamentos podem não corresponder à tolerância a risco da sua organização, aos seus requisitos regulatórios ou às expectativas dos seus clientes. Um modelo com boa pontuação no Claw-Eval é seguro pela definição do Claw-Eval. Se é seguro pela sua definição, essa é outra questão.

A escala de 300 tarefas merece escrutínio. É grande o bastante para ser significativa na comparação entre modelos. É pequena o bastante para levantar questões sobre cobertura. Nove categorias distribuídas em 300 tarefas significam cerca de 33 tarefas por categoria. É um ponto de partida, não cobertura abrangente.

O Problema do Harness

O insight mais profundo do paper da Anthropic trata da deterioração do harness. Conforme os modelos melhoram, as premissas embutidas nos harnesses de agentes ficam desatualizadas. Um harness projetado para um modelo que precisa de scaffolding de cadeia de pensamento vira overhead para um modelo que raciocina nativamente. Um harness projetado para um modelo que alucina schemas de ferramentas vira restrição desnecessária para um modelo que usa ferramentas com confiabilidade.

Por isso orquestração de agentes importa no nível de infraestrutura, não apenas no nível de aplicação. Se sua camada de orquestração codifica premissas específicas do modelo, você está construindo sobre uma fundação que se deteriora a cada release.

A resposta da Anthropic é decomposição. Separar a camada de raciocínio da camada de execução da camada de sessão. Quando o modelo melhora, troque o cérebro. As mãos e a sessão permanecem estáveis.

A implicação organizacional é que políticas de governança precisam da mesma decomposição. Seu modelo de permissões, sua trilha de auditoria, seus requisitos de conformidade e seus critérios de segurança são preocupações separadas. Agrupar tudo numa única camada de governança cria a mesma fragilidade que agrupar modelo e ferramentas num único harness. Quando um requisito de governança muda (uma nova regulação, uma nova avaliação de risco, um novo contrato com cliente), você deveria poder atualizar essa camada específica sem reconstruir todo o stack de governança.

O Que Isso Significa Para Decisões de Infraestrutura

Três implicações concretas para equipes construindo infraestrutura de agentes.

Decomponha seu stack de governança, não apenas seu stack de agentes. Se a Anthropic está certa que harnesses monolíticos codificam premissas obsoletas, o mesmo vale para políticas de governança monolíticas. Separe controles de permissão de requisitos de auditoria de critérios de segurança. Cada um muda num ritmo diferente e por razões diferentes.

Adote avaliação baseada em trajetória desde cedo. A auditoria de trajetória completa do Claw-Eval custa mais que avaliação apenas de resultado. É também a única forma de identificar agentes que produzem resultados corretos por processos inseguros. Se sua avaliação verifica apenas saídas, você está construindo confiança numa métrica que não captura os riscos relevantes.

Escreva suas próprias rubricas de segurança. O Claw-Eval oferece um framework. Não oferece a tolerância a risco da sua organização. As rubricas do benchmark são ponto de partida. Sua equipe de compliance, seu jurídico e seus especialistas de domínio precisam definir o que “seguro” significa no seu contexto. Depois você precisa de infraestrutura de avaliação que avalie segundo essas definições, não apenas segundo benchmarks genéricos.

O stack de infraestrutura de agentes está endurecendo. Primitivas de governança estão se tornando combináveis. Frameworks de avaliação estão ficando mais rigorosos. O trabalho que resta é organizacional: decidir o que governança significa para o seu contexto específico e codificar essas decisões na infraestrutura que agora as suporta.

Fontes

- Anthropic. “Managed Agents.” Fevereiro 2026. Por Lance Martin, Gabe Cemaj e Michael Cohen.

- Lei Li et al. “Claw-Eval.” arXiv 2604.06132v1. Março-Abril 2026.

Victorino Group ajuda organizações a construir infraestrutura de governança que reflete sua própria tolerância a risco, não apenas padrões de fornecedor: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa