- Início

- The Thinking Wire

- Anthropic Opera com Um Nove. A Resposta da Meta É Skills Como Substrato de Throughput

Anthropic Opera com Um Nove. A Resposta da Meta É Skills Como Substrato de Throughput

No dia 28 de abril de 2026, a Anthropic teve mais uma indisponibilidade. Cerca de uma hora e meia. No fio de comentários do post-mortem, Lorin Hochstein apontou a conta que deveria fazer todo líder de plataforma parar para pensar: a disponibilidade do Claude Code está agora em “um nove nos últimos 60 dias” e “dois noves nos últimos 90 dias”. Para um serviço que times de engenharia plugaram no caminho crítico do dia a dia, é o tipo de número que normalmente só aparece no status page de um provedor regional durante uma tempestade.

O instinto, quando um provedor de LLM erra a meta de uptime, é tratar como problema de fornecedor. Abrir um ticket. Exigir mais capacidade. Esperar o próximo post-mortem. Mas o enquadramento de Hochstein em Life Comes At You Fast corta na direção oposta. Ele argumenta, de forma direta, que “LLMs têm mais probabilidade de estar do lado da oferta quando se trata de risco de saturação”. Eles não são a válvula de alívio. São a mangueira de incêndio.

Essa é a frase com a qual queremos sentar. Porque na mesma semana em que a Anthropic emitia desculpas, o time de engenharia da Meta publicava a resposta arquitetural. E não é uma resposta sobre mais computação. É uma resposta sobre como expertise sênior é codificada para que o sistema continue funcionando quando a curva de carga ultrapassa a curva de pessoas.

A Tese da Saturação

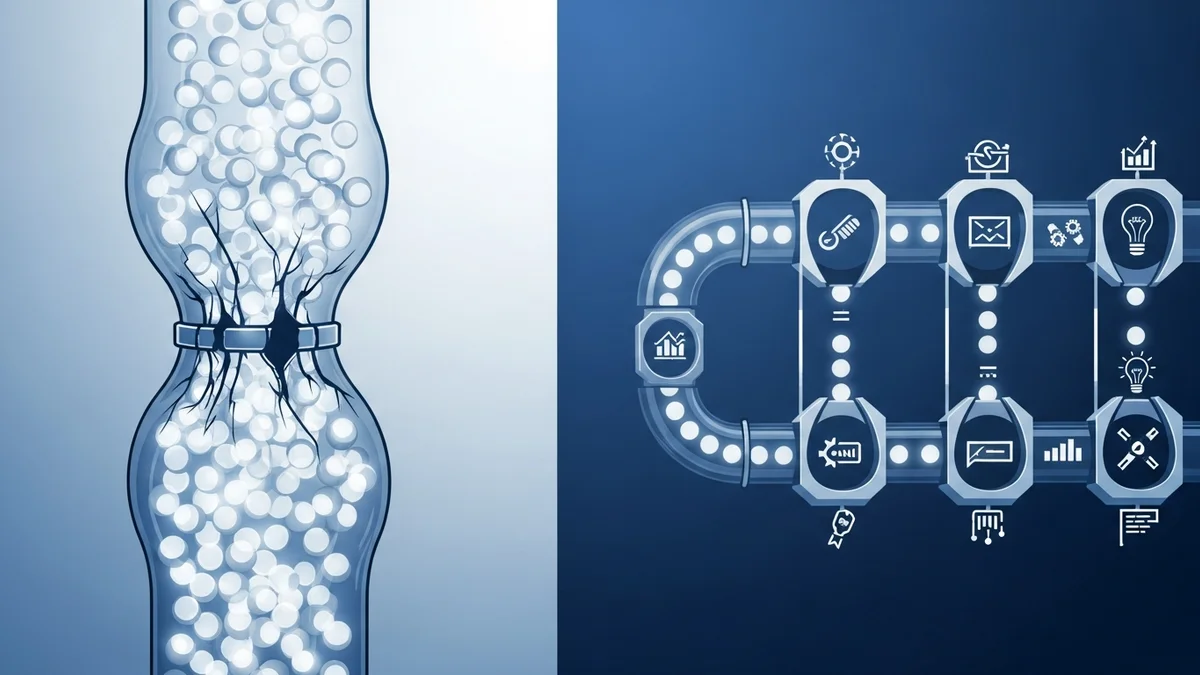

O modelo ingênuo de IA em produção assume que o modelo é um multiplicador de produtividade sobre uma linha de base fixa de throughput. Você joga agentes no pipeline e os mesmos fluxos terminam mais rápido. A realidade operacional, como Hochstein aponta, é o oposto. Agentes geram PRs. Agentes geram commits. Agentes geram pedidos de review. Agentes geram execuções de testes. As filas do GitHub estão crescendo, não porque a plataforma ficou mais lenta, mas porque a oferta upstream de trabalho cresceu mais rápido do que a capacidade downstream de absorver.

Já escrevemos sobre essa dinâmica antes, quando o pipeline ainda estava apenas sufocando com o próprio sucesso. Seis semanas depois, o sufocamento é menos metáfora e mais medição. Filas de CI alongam. Slots de validação são racionados. Os próprios provedores de inferência erram seus noves. O lado da oferta é a IA. A restrição está em todo lugar a jusante.

Esta é a frase que importa: um sistema cuja restrição vinculante migra de esforço humano para throughput de validação não pode ser governado com políticas desenhadas para trabalho em ritmo humano. Os artefatos chegam rápido demais. Revisores não acompanham. A fila de escalação é a nova dívida técnica.

O Que a Meta de Fato Construiu

O post Capacity Efficiency at Meta, na superfície, é um anúncio de tecnologia. Eles unificaram a tooling interna de performance e capacidade sob uma plataforma de agentes de IA. Existe um AI Regression Solver. Existe o FBDetect, que captura “milhares de regressões por semana”. Existe um sistema de roteamento fix-forward que envia PRs gerados automaticamente para o autor original da causa raiz. Existem “centenas de megawatts de potência” recuperados.

Leia uma vez e soa como mais uma hyperscaler se vangloriando de hyperscaling. Leia duas vezes e o blueprint real aparece. A Meta não resolveu o problema de saturação contratando mais engenheiros de performance ou comprando mais datacenters. Resolveu separando duas camadas que a maioria das organizações ainda mistura.

A primeira camada são as MCP tools. No enquadramento da Meta, cada ferramenta faz uma coisa: consultar uma métrica, buscar um profile, descobrir o owner de um serviço. Uma tool é um verbo num vocabulário finito e determinístico. O agente não decide o que uma tool significa. O contrato da tool decide.

A segunda camada são as skills. E é aqui que o enquadramento se paga. A Meta descreve skills como padrões de raciocínio de engenheiros sêniores codificados. Uma skill é o fluxo que um engenheiro de performance experiente percorreria ao fazer a triagem de uma regressão. Puxe esta métrica primeiro. Se cruzou este limiar, puxe aquele profile. Se o profile mostra esta assinatura, cheque aqueles callers. Se os callers incluem este owner, abra fix-forward na fila dele. A skill não é a improvisação do LLM. É o playbook do engenheiro sênior, escrito uma vez, executado em todo lugar.

O AI Regression Solver comprime o que costumava ser dez horas de investigação manual em cerca de trinta minutos. Isso não é capacidade do modelo. É capacidade da skill. O modelo é o motor. A skill é a rota.

Por Que Skills São o Substrato

Já argumentamos antes que skills são a unidade certa de governança modular de IA. Na época, o argumento era principalmente sobre segurança e consistência: codifique a restrição uma vez, faça valer em todo lugar, não deixe cada time reinventar a mesma fronteira de aprovação. O deployment da Meta transforma a mesma arquitetura num argumento de throughput.

Quando expertise sênior vive em cabeças, a única forma de escalar um fluxo de triagem é contratar mais engenheiros sêniores. Quando expertise sênior vive em skills, o mesmo fluxo escala com computação. O FBDetect da Meta captura milhares de regressões por semana. Não existe versão da matemática de headcount que feche essa conta. Existe uma versão da matemática de skills que fecha, e é a que está em produção.

Essa é a reformulação que muda como um time de plataforma deveria pensar seu roadmap de 2026. A conversa sobre agentes não é mais “deveríamos deixar um agente tocar em X”. A conversa é “quais dos padrões de decisão dos nossos engenheiros sêniores ainda estão presos nas cabeças deles, e com que velocidade conseguimos movê-los para skills antes que a oferta esmague a revisão”.

Algumas implicações práticas seguem.

Skills são infraestrutura, não conteúdo. Vivem ao lado dos seus pipelines de CI, do seu catálogo de serviços, dos seus runbooks de incidente. São versionadas, revisadas e testadas do mesmo jeito que configuração de deploy é versionada, revisada e testada. Uma skill que ninguém auditou em seis meses é vetor de regressão, não feature.

MCP e skills não são a mesma camada. Tools são verbos determinísticos com contratos estáveis. Skills são padrões de raciocínio que compõem esses verbos. Misturar os dois, deixar uma tool codificar lógica de fluxo, ou deixar uma skill burlar o contrato da tool, colapsa a arquitetura e reintroduz a improvisação sem limites que skills existem para remover.

O padrão fix-forward é a lição de governança. O agente da Meta não apenas detecta uma regressão. Ele gera um PR corretivo e roteia para o engenheiro cuja mudança causou a regressão. Detecção sem roteamento é backlog. Roteamento sem ownership é fila. Skills que fecham o loop, encontrar, corrigir, mandar para o humano responsável, são as únicas que traduzem computação em capacidade recuperada.

A Pergunta para Times de Plataforma

O trimestre de um-nove da Anthropic não é uma denúncia da Anthropic. É indicador antecedente de onde toda plataforma dependente de IA está caminhando se a pressão do lado da oferta continuar superando o substrato que transforma output do modelo em trabalho confiável. Você pode esperar seu provedor adicionar noves, ou pode construir o substrato que faz esses noves importarem menos.

O substrato são skills. Expertise sênior codificada, versionada como infraestrutura, executada por agentes que seguram contratos determinísticos de tools e roteiam outputs para owners responsáveis. É a arquitetura que a Meta descreveu em abril. É a arquitetura que a curva de saturação vai exigir de todos os outros nos próximos dois trimestres.

A escolha não é se adotar agentes. A escolha é se a expertise sênior da sua organização permanece presa em agendas e threads de Slack, ou migra para a camada de skills onde pode absorver o throughput que seus agentes estão prestes a despejar.

Skills não são infraestrutura opcional. Em hiperescala, são o único jeito de manter as luzes acesas.

Fontes

- Lorin Hochstein / Adaptive Capacity Labs. “Life Comes At You Fast.” Abril de 2026.

- Meta Engineering. “Capacity Efficiency at Meta, How Unified AI Agents Optimize Performance at Hyperscale.” Abril de 2026.

A Victorino ajuda times de plataforma a codificar expertise sênior em skills antes que a saturação quebre o pipeline: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa