- Início

- The Thinking Wire

- O Valor da IA Está Saindo da Camada de Modelo. Eis os Três Lugares para Onde Está Indo.

O Valor da IA Está Saindo da Camada de Modelo. Eis os Três Lugares para Onde Está Indo.

Na primeira semana de maio de 2026, três analistas diferentes publicaram textos que, à primeira vista, não têm relação. Charles Betz, da Forrester, escreveu sobre Atlassian e ServiceNow apostando pesado em grafos de contexto. Pierre DeBois, na CMSWire, perguntou se a volta do Google Data Studio sinaliza o fim dos silos de analytics. Revanth Krishna, no UX Collective, argumentou que IA “bolt-on” é estruturalmente quebrada porque obriga o usuário a aprender o vocabulário do sistema, em vez do contrário.

Revistas diferentes. Públicos diferentes. Vocabulários diferentes.

Uma única tese: o valor da IA parou de se acumular na camada de modelo. Está migrando, e está migrando em três direções específicas ao mesmo tempo.

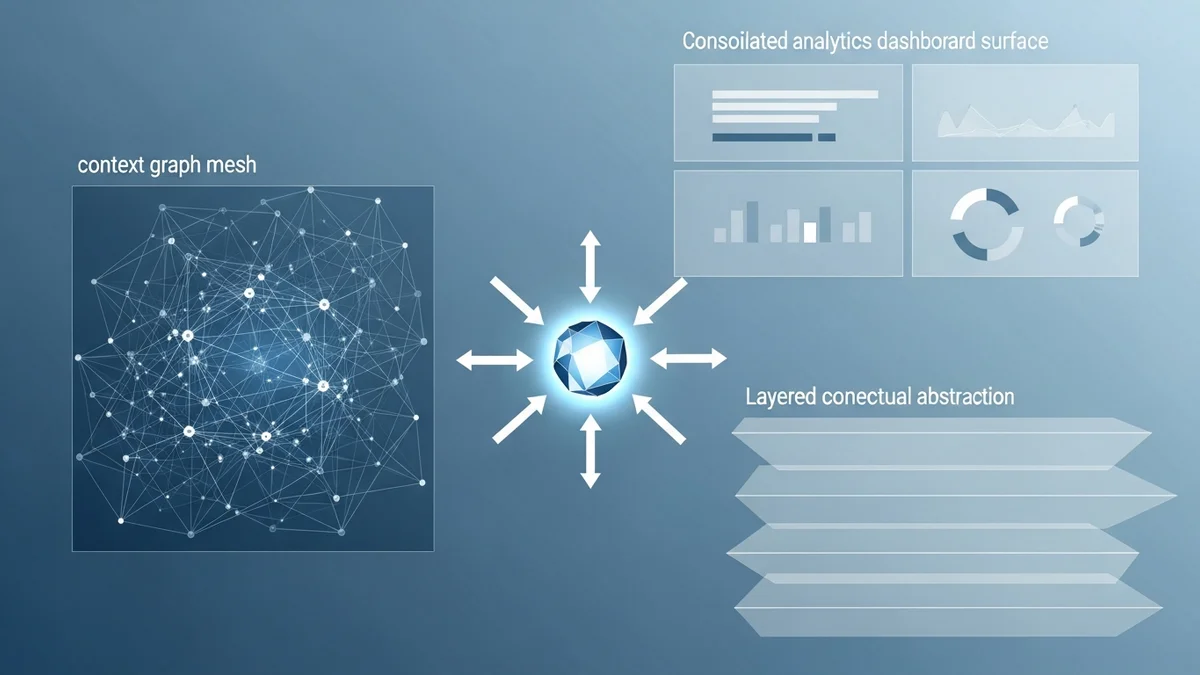

Para quem opera um negócio de plataforma, esta é a semana de ler os três textos e perguntar onde, de fato, sua barreira competitiva mora hoje. Performance de modelo virou requisito básico. Os próximos dois anos de vantagem competitiva pertencem a quem dominar o grafo operacional embaixo do modelo, a superfície de analytics consolidada acima dele e a abstração conceitual que o usuário de fato toca. Três vetores. Três posições defensáveis distintas. Poucas empresas estão posicionadas para mais de uma.

Vetor Um: O Grafo Operacional

O texto da Forrester sobre Atlassian e ServiceNow faz uma afirmação direta. As duas plataformas dominantes de gestão de TI habilitada por IA convergiram para a mesma estratégia, e essa estratégia não é “modelo melhor”. É “grafo mais rico”.

A ServiceNow anunciou o Context Engine em 9 de abril de 2026. O Context Engine unifica quatro grafos que antes viviam em produtos separados: o Service Graph (o CMDB), o Knowledge Graph (documentação, tickets, runbooks), o grafo de ativos cibernéticos que veio com a aquisição da Armis e o grafo de acesso que veio com a Veza. A ServiceNow afirma que o engine aprende a partir de “85 bilhões de workflows e 7 trilhões de transações por ano”. Esse número não é floreio de marketing. É a barreira.

O Teamwork Graph da Atlassian cruzou 100 bilhões de objetos e conexões na mesma janela, e a aquisição da Secoda em dezembro de 2025 acrescentou catalogação semântica em cima do grafo existente. Mesma direção. Ponto de partida diferente.

O que as duas empresas estão dizendo, sem dizer com todas as letras, é que um LLM ligado a um índice genérico de web é truque de salão em contexto corporativo. O trabalho que importa acontece contra um corpus específico de serviços, tickets, runbooks, identidades e dependências. Quem domina o grafo de como essas coisas se relacionam de fato está posicionado para tornar o LLM útil. Quem não domina está posicionado para virar funcionalidade de outra empresa.

Fizemos uma observação relacionada ao analisar o Cloud Next, em que o argumento do Google sobre grafos de conhecimento como contexto de agente seguia a mesma lógica do lado da plataforma de cloud. As plataformas que já têm o grafo operacional, por acidente ou por desenho, não estão correndo para construir modelos. Estão correndo para expor seu grafo a qualquer modelo que o cliente preferir.

O teste de defensabilidade para o vetor um: se você trocasse o provedor de LLM atual por um concorrente amanhã, o grafo operacional embaixo dele continuaria sendo seu? Se sim, a barreira é real. Se não, a barreira é de outra empresa.

Vetor Dois: A Superfície Consolidada de Analytics

O texto da CMSWire sobre o rebranding do Google Data Studio parece, na superfície, um analista de marketing comentando uma renomeação de produto. Releia. Pierre DeBois está descrevendo consolidação de plataforma como estratégia de governança.

Em abril de 2026, o Google rebatizou o Looker Studio de volta para Data Studio e lançou o tier Pro. A mecânica importa mais do que o nome. O Data Studio agora roda agentes conversacionais nativos do BigQuery dentro do dashboard. Notebooks Colab convivem com relatórios. Dados de marketing, vendas e atendimento compartilham definições semânticas, o que significa que um agente de IA perguntando “como a campanha está performando” recebe a mesma resposta independentemente da superfície que pergunta. O Data Studio Pro adiciona automação de workflow com IA, orquestração multi-cloud e resposta autônoma em tempo real a anomalias.

DeBois lê a consolidação como o fim dos silos de analytics. A leitura mais profunda é que a camada de analytics está virando a superfície de governança da IA. Quando agentes precisam agir sobre números, eles precisam de números consistentes. Quando humanos precisam sobrescrever a interpretação de um agente, precisam de um único dashboard onde o override se propaga. Quando auditores perguntam por que um agente tomou uma decisão, precisam de uma única superfície de explicação, não de sete.

Argumentamos algo parecido sobre a camada semântica do Looker no Cloud Next: semântica consistente entre superfícies é o que permite a agentes e humanos raciocinar sobre os mesmos números sem tradução manual. A leitura da CMSWire leva o argumento um passo adiante. A consolidação não é só uma melhoria de qualidade de vida para analistas. É a pré-condição para deixar agentes agirem com consequências mensuráveis.

O teste de defensabilidade para o vetor dois: se o seu negócio roda três ferramentas de analytics hoje, com três definições de “cliente ativo” e três pipelines de reconciliação, agentes não conseguem operar em cima dessa bagunça de forma auditável. As empresas que consolidaram antes da chegada dos agentes compraram para si uma superfície de governança. As que não consolidaram estão prestes a descobrir que a primeira falha do agente é “os números discordaram”.

Vetor Três: A Abstração Conceitual

O texto de Revanth Krishna no UX Collective é o que nomeia o terceiro vetor de forma explícita. O argumento dele: IA “bolt-on” falha porque não muda o modelo conceitual que o usuário precisa aprender. Apenas adiciona uma caixa de chat na mesma tela.

O exemplo é certeiro. “O assistente da AWS hoje fala a língua da AWS”, escreve. O usuário precisa saber o que é um bucket S3, o que é uma região, o que é uma política de versionamento, antes de conseguir fazer uma pergunta útil. A versão IA-nativa, no enquadramento dele, “faz duas perguntas de esclarecimento em linguagem simples e devolve uma URL de armazenamento, sem exigir vocabulário AWS”. A mesma infraestrutura por baixo. Um contrato conceitual diferente com o usuário.

É aqui que a maioria dos esforços corporativos de IA está falhando agora. Times estão plugando interfaces de chat em produtos existentes e descobrindo que a adoção empaca na curiosidade. A razão é estrutural. A interface de chat fala o vocabulário antigo do produto. O usuário ainda precisa traduzir o objetivo dele para esse vocabulário. A fricção que a caixa de chat deveria remover continua lá, só que atrás de mais um clique.

A camada conceitual é a superfície de governança não endereçada. Também é o lugar onde a maioria dos times de produto ainda não está pensando em defensabilidade. Argumentamos em um texto anterior sobre operação de agentes guiada por avaliação que a camada operacional precisa ser redesenhada para tráfego de agente. A camada conceitual é a mesma observação feita um andar acima. A interface precisa ser redesenhada para usuários que não precisam mais saber como o produto foi construído.

O teste de defensabilidade para o vetor três: abra a superfície principal de IA do seu produto. Pergunte a um não-especialista o que ele diria a ela para resolver algo útil. Se a primeira frase dele exigir conhecimento do vocabulário do seu produto, a barreira conceitual será construída por outra empresa.

O Que Isso Significa Para Estratégia de Plataforma

Três vetores. Três posições defensáveis distintas. Não são intercambiáveis.

O grafo operacional é jogo longo. Ele se acumula a cada transação que a plataforma processa, e é difícil de copiar porque está embutido em como o cliente já opera. Atlassian e ServiceNow têm porque rodam os workflows há anos. Um novo entrante consegue construir um modelo melhor em seis meses. Não consegue construir um grafo de 100 bilhões de objetos em seis meses.

A superfície consolidada de analytics é uma função de pressão. Empresas que rodarem agentes de IA em cima de analytics fragmentada vão passar os próximos dois anos explicando por que a resposta do agente diverge do dashboard. Empresas que consolidaram primeiro vão passar esses dois anos entregando produto. A janela para consolidar antes de os agentes chegarem em produção está se fechando.

A abstração conceitual é a mais difícil das três porque exige descartar o vocabulário em torno do qual o produto foi construído. A maioria dos times de produto não consegue fazer isso sem mandato da liderança, porque o vocabulário existente está codificado na documentação, no treinamento do time de suporte, na superfície de API e na memória muscular de cada cliente. Os times que conseguirem vão parecer óbvios em retrospecto. Os que não conseguirem vão ser lembrados como a versão “vocabulário-AWS” da categoria que costumavam liderar.

A tese não é que a camada de modelo deixou de importar. É que a camada de modelo deixou de diferenciar. Três analistas distintos, olhando de três pontos de vista distintos, chegaram à mesma conclusão na mesma semana. As empresas que descobrirem qual dos três vetores estão posicionadas para dominar, e investirem de acordo, vão se compor. As empresas ainda apostando em um modelo melhor vão descobrir, em algum momento de 2027, que o modelo está bom o suficiente para todo mundo e que a barreira competitiva sempre esteve em outro lugar.

Fontes

- Forrester / Charles Betz. “Atlassian and ServiceNow Lean into Context Graphs.” Maio de 2026.

- CMSWire / Pierre DeBois. “Does the Return of Google Data Studio Signal the End of Analytics Silos?.” Maio de 2026.

- UX Collective / Revanth Krishna. “Don’t Simply Bolt On AI. Rethink From the Ground Up..” Maio de 2026.

A Victorino ajuda líderes de plataforma a identificar quais barreiras sobrevivem à comoditização do modelo: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa