- Início

- The Thinking Wire

- O Viés do Fornecedor na Produtividade de IA: Sua Métrica de IDE É Marketing, Não Auditoria

O Viés do Fornecedor na Produtividade de IA: Sua Métrica de IDE É Marketing, Não Auditoria

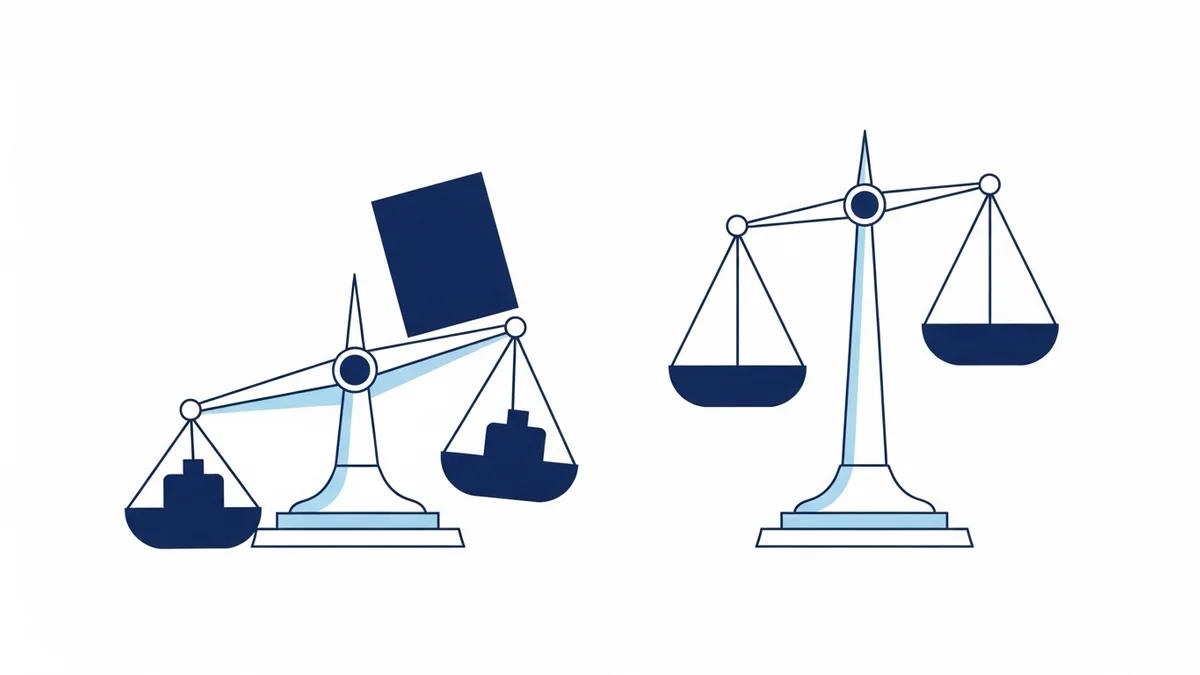

William O’Connell rodou a mesma tarefa de codificação em dois IDEs de IA, um logo após o outro. O Windsurf disse que o trabalho era 98% gerado por IA. O Cursor disse que era 52,6%. Mesma tarefa. Mesmo desenvolvedor. Mesma saída. Uma diferença de 45 pontos dependendo de qual fornecedor estava segurando a régua.

Esse número é o problema inteiro.

Quando conselhos perguntam “qual a porcentagem do nosso código gerada por IA?”, assumem que a resposta vem de uma medição. Não vem. Vem de um instrumento calibrado pela empresa que lucra quando a resposta é maior. Todo fornecedor de IDE que vende assistência de IA tem incentivo comercial para inflar a atribuição — e as metodologias que usam, documentadas na análise de 22 minutos de O’Connell, fazem exatamente isso (Your AI Might Be Lying to Your Boss, abril 2026).

Não é um problema de mensuração. É um problema fiduciário disfarçado de dashboard.

As Metodologias Foram Construídas para Inflar

A análise de O’Connell rastreia a mecânica. A atribuição do Windsurf conta texto colado e símbolos auto-completados como gerados por IA. O Cursor usa um rastreador baseado em linhas, mais conservador, que tropeça em edições espalhadas. Nenhum dos fornecedores publica a metodologia em detalhe suficiente para reprodução. Nenhum se submete a auditoria de terceiros. Os dois entregam o número direto no dashboard do seu CTO.

A assimetria se acumula. Se você é um desenvolvedor que refatora três linhas em nove arquivos depois de um trecho colado longo, o Windsurf vai contar o trecho como IA e ignorar a refatoração. O Cursor vai contar a refatoração como humana e ignorar o trecho. Qualquer ferramenta que sua equipe padronizou vira a fonte da verdade — e a fonte da verdade foi escolhida por motivos que não tinham nada a ver com validade da medição.

Esse é o problema estrutural que não nomeamos em A Dívida de Verificação de IA. Aquele ensaio argumentou que a lacuna de verificação é organizacional. Este vai uma camada mais fundo: antes mesmo da verificação, o dado de atribuição já está contaminado na camada do fornecedor. Não é possível governar o que não se consegue medir com honestidade.

Os Números Que Executivos Citam Não São Mensurações

Executivos da indústria passaram os últimos doze meses publicando taxas de geração de código por IA como KPIs públicos. 30% nesta empresa. 50% naquela. 75% nos anúncios mais agressivos. Esses números viajam dos dashboards dos fornecedores para chamadas de resultado, decks de conselho e decisões de quadro de pessoal.

Nenhum deles sobrevive a uma única pergunta de auditoria. Qual metodologia de qual fornecedor produziu o número? O que está excluído? Blocos colados foram contados? Símbolos auto-completados? Andaimes de teste gerados versus lógica de negócio gerada? Quando o executivo não consegue responder, o número não é uma métrica. É um material de marketing que escapou do departamento de marketing.

A consequência jurídica é concreta. Código gerado por IA, sob a orientação atual do US Copyright Office, não tem proteção autoral. Uma organização que declara 75% de geração por IA em arquivamentos públicos também está declarando publicamente que 75% da sua base de código é trabalho desprotegido. A maioria dos conselhos que anunciam esses números não consultou o jurídico sobre a implicação. Estão otimizando para uma frase de efeito numa apresentação a analistas e aceitando uma exposição de PI que não foi precificada.

Construindo sobre O Espectro da Adoção de IA, a questão mais profunda é que métricas de fornecedor achatam uma distribuição num único número performativo. Não há espectro visível em “somos 50% IA”. Não há sinal sobre quais 50%, feitos por quem, com qual padrão de revisão. A métrica nunca foi desenhada para sustentar governança. Foi desenhada para sustentar vendas.

O Custo Não Medido Que Devora a Manchete

Todo número de produtividade vindo de um IDE de fornecedor mede geração. Nenhum mede o que vem depois da geração: tempo de revisão, ciclos de depuração, testes de regressão, trabalho de rollback, falhas em produção rastreadas até código quase-correto que ninguém leu com atenção suficiente.

A bagunça é o trabalho, como o TLDR Founders enquadrou recentemente (The Mess Is The Work, abril 2026) — o trabalho de coordenação, julgamento e verificação que transforma saída gerada em software entregue. O ensaio Simulacrum of Knowledge Work faz o mesmo argumento sobre IA em trabalho intelectual de forma mais ampla: um artefato gerado que se parece com trabalho não é o trabalho (Simulacrum of Knowledge Work, abril 2026). O trabalho é a consequência que o artefato tem sobre o sistema.

É por isso que o número de 98% não é apenas impreciso. É estruturalmente enganoso. Mesmo que o número do Windsurf fosse honesto sobre geração, seria silencioso sobre consequência. A fração do código que veio de IA não diz nada sobre a fração de esforço de engenharia, carga de revisão ou risco em produção que veio de IA. Esses números são maiores, mais difíceis de manipular e exatamente os que ninguém está reportando.

O Que o Discord Fez Quando Parou de Confiar no Dashboard

A contraevidência vem de dentro de uma equipe de engenharia que decidiu que o próprio sistema de medição estava mentindo para ela. A equipe de experimentação do Discord descobriu que rodar cerca de 50 métricas padrão em cada teste produzia tanto ruído que o sinal real estava sendo soterrado. Cortaram o conjunto padrão para 15. Resultado: melhoria de 45% na capacidade de detectar efeitos reais (Measure Less to Learn More, abril 2026).

A lição não é “menos métricas”. A lição é que volume de métricas pode destruir ativamente sua capacidade de enxergar o que importa. Quando você instrumenta tudo, o piso de ruído sobe, o problema de comparações múltiplas se multiplica, e o dashboard diz que algo está acontecendo quando nada está — ou que nada está acontecendo quando algo está. A equipe do Discord tratou a própria infraestrutura de mensuração como uma coisa que podia estar errada, auditou e reconstruiu.

Esse é o movimento que conselhos ainda não fizeram em produtividade de IA. Continuam tratando o dashboard do fornecedor como verdade absoluta. O dado do Discord diz que o caminho é o oposto: assuma que o instrumento é enviesado, reduza a área de superfície e desenhe mensuração que sobreviva a uma auditoria que você não controla.

O Que Sobrevive a uma Auditoria

Um sistema de mensuração que sobrevive a auditoria é aquele que um conselho conseguiria defender numa deposição. Não pode depender da metodologia proprietária de um único fornecedor. Não pode contar saídas que ninguém revisou. Não pode omitir o custo de levar essa saída até produção. E não pode ser calibrado por uma parte que lucra com o resultado.

Para organizações que pretendem publicar números de produtividade de IA — internamente ou externamente — a implicação é desconfortável. Os instrumentos entregues pelo seu fornecedor de IDE não são adequados. Foram construídos para impulsionar a adoção deles, não a sua governança. Construir um sistema de mensuração que sobreviva a auditoria significa medir na camada de commit e PR, não na de teclado; contar tempo de revisor, não eventos de geração; rastrear incidentes de produção rastreáveis até contribuições assistidas por IA; e tratar qualquer número fornecido por fornecedor como sinal direcional, no máximo, nunca como métrica citável.

É trabalho sem glamour. Não se parece em nada com o dashboard. Também é a única versão de “produtividade de IA” que não desmorona no momento em que um regulador, um litigante ou um analista sério pergunta como o número foi produzido.

A diferença entre 98% e 52,6% é o canário. Diz que o instrumento está quebrado na camada do fornecedor. A pergunta é se sua organização vai continuar citando o número quebrado, ou construir aquele que um conselho pode de fato defender.

Fontes

- O’Connell, William. “Your AI Might Be Lying to Your Boss.” Abril 2026.

- Discord Engineering. “Measure Less to Learn More.” Abril 2026.

- happyfellow.dev. “Simulacrum of Knowledge Work.” Abril 2026.

- TLDR Founders. “The Mess Is The Work.” Abril 2026.

A Victorino ajuda conselhos e CTOs a construir medição de produtividade de IA que sobrevive a auditoria: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa