- Início

- The Thinking Wire

- A IA Come a Coordenação. A Propriedade Resiste.

A primeira pergunta não é o que a IA faz. É sobre que tipo de trabalho ela faz bem.

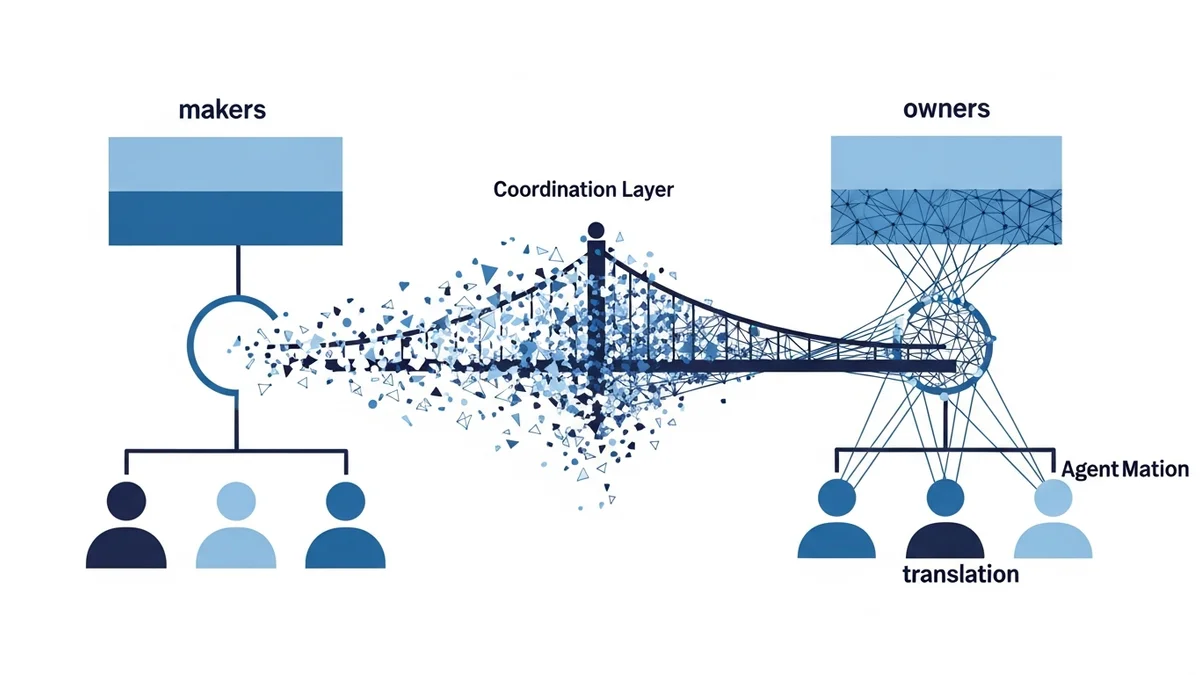

Se você dividir coordenação em três camadas, o debate fica mais honesto. Primeira camada: sincronia. Atualizar status, resumir reunião, limpar ticket, rotear pedido para o time certo. Segunda camada: julgamento. Decidir se um bug bloqueia release, se um cliente merece escalada, se uma candidata entra no pipeline. Terceira camada: propriedade. Comandar um incidente, assinar um relatório regulatório, responder por um lançamento na segunda-feira às sete da manhã.

A IA industrializa sincronia rápido. A sincronia tem modo de falha limitado. O pior resultado costuma ser um parágrafo estranho no Notion. Julgamento é contestado; a falha aparece em acordos quebrados e confiança erodida. Propriedade é ilimitada; a falha aparece em processo judicial, incidente com cliente, carreira encerrada.

A linha prática de 2026 não é “IA substitui média gerência”. É uma engenharia de gradiente: automatize sincronia, proteja propriedade, e trate julgamento como superfície que muda com o contexto.

O caso anônimo e o que ele prova

Esta semana um CTO escrevendo anonimamente no Substack descreveu uma implantação que circulou bastante. A empresa é descrita como um SaaS B2B de observabilidade com cerca de quarenta pessoas. Ele afirma ter colocado em produção uma malha de agentes LangGraph: quatro containers no ECS, em torno de 4 mil linhas de Python, Claude Sonnet 4.6 como modelo principal e Opus 4.6 reservado para decisões de roadmap semanal. Sua frase sobre custo é comparativa, não absoluta. A operação gasta menos em tokens por mês do que um engenheiro sênior custa por semana.

Esse número merece cuidado. Não é “US$ 4 mil por mês”. É uma ordem de grandeza que, mesmo assim, dispara uma pergunta de CFO: se o piso for esse, a conversa já mudou de demo para linha de orçamento.

O autor também afirma que seis de nove cargos da média gerência “seguiram em frente”. Mas ele só divulga o destino de dois: um foi para uma cadeira sênior de engenharia dentro da empresa, outro para um papel voltado ao cliente. Quatro destinos não aparecem. Não sabemos o que foi saída voluntária, o que foi acordo, o que foi demissão com rescisão. Qualquer leitura que achate isso em “transição feliz” está editorializando.

A peça é pseudônima, com cinco dias de vida e sete compartilhamentos. Trate como ilustração, não como evidência. O valor está na arquitetura descrita e no heurístico que o autor propõe (“se o pior caso for um parágrafo estranho no Notion, automatize”), não nas pessoas contadas na passagem.

O histórico recente diz o resto

A Klarna anunciou em 2024 que sua IA fazia o trabalho de 700 agentes de atendimento. Em meados de 2025, o CEO voltou atrás e começou a recontratar humanos, afirmando que atendimento “é coisa de VIP”. O que quebrou não foi a triagem de tickets. Foi a camada de relacionamento: reclamações difíceis, de-escalada, edge cases emocionais. A sincronia aguentou; a propriedade do relacionamento quebrou.

A IBM é o outro lado da mesma moeda. O AskHR resolve 94% das consultas de recursos humanos. Os 6% restantes são os mais difíceis: casos sensíveis, éticos, emocionais. E o detalhe que raramente aparece no discurso de palco: o headcount total da IBM cresceu depois do programa. A automação liberou capacidade; não eliminou o quadro. “IA substitui humanos” virou, na prática, “IA redistribui humanos”.

O terceiro dado é menos confortável. A Runframe publicou que toil operacional subiu 30% em 2025, o primeiro aumento em cinco anos, apesar dos investimentos pesados em IA. O mecanismo é conhecido por quem opera agentes em escala: a IA gera superfície nova mais rápido do que absorve carga operacional. A coordenação que sai pela porta da frente volta pela janela, disfarçada de dívida de avaliação, dívida de observabilidade e dívida de on-call.

Como exploramos em Operações de Agentes em Escala de Produção, os times que operam agentes em produção não ganham eficiência por colocar mais agentes. Ganham por instrumentar a camada de avaliação antes de escalar a camada de execução.

O caso limítrofe tem nome

Comando de incidente é onde a taxonomia se confunde. O trabalho do comandante (reunir responders, rotear informação, decidir quem fala com o cliente) é literalmente coordenação. Playbooks de PagerDuty, Rootly e Splunk descrevem exatamente isso. E agentes já absorvem pedaços desse trabalho: coleta de contexto, correlação de alertas, rascunho de timeline.

Mas a responsabilidade não transfere. Quando o relatório post-mortem sai, um humano assina. Quando o órgão regulador pergunta o que foi feito às 3h12, um humano responde. A forma que emerge não é “IA come o comandante de incidente”. É: a IA industrializa parte do trabalho de coordenação, enquanto a propriedade do papel se concentra em menos humanos, mais seniores, mais expostos.

Vale para comando de incidente. Vale para escalada executiva de cliente. Vale para resposta regulatória. O mesmo padrão aparece em Rampa de Adoção de IA e Design Organizacional: empresas que escalam adoção sem quebrar não removem camadas, reformatam o que cada camada é responsável por entregar.

Economia de unidade, lida com honestidade

A economia do caso anônimo é dramática no cenário descrito. Mas quem usa essa matemática para orçar precisa três asteriscos visíveis.

Primeiro, o custo carregado de um gerente varia de 2x a 3x entre mercados. O salário mais encargos de um engineering manager em São Francisco não é o mesmo que em Austin, Lisboa ou Bangalore. Multiplicadores de economia que parecem de 20x num mercado viram 6x em outro.

Segundo, “gasto em tokens” não é TCO. Falta contabilizar assentos de LangSmith ou equivalente, infraestrutura de avaliação, on-call para falhas de agente, trabalho de engenheiro de prompt, e o custo de migração quando um modelo é aposentado. Tokens caíram cerca de 10x ao ano entre 2023 e 2025. Avaliação, on-call e switching não caíram. Se o seu modelo econômico ignora essas linhas, ele é otimista por um fator de 2 a 4.

Terceiro, o contexto importa. Uma empresa de observabilidade rentável, com seis anos de história e instrumentação própria, opera agentes com custo de telemetria que quase ninguém mais tem. Uma empresa regulada (finanças, saúde, setor público) adiciona 5x a 10x de overhead em auditoria, revisão humana e trilha de conformidade. O teste do “pior caso é um parágrafo estranho no Notion” não sobrevive ao primeiro contato com discovery jurídico.

Como discutimos em O Stack Interno da Cloudflare como Prova de Governança, empresas que dogfoodam governança em seus próprios produtos internos absorvem esse custo dentro do ciclo normal de engenharia. Quem não tem esse músculo vai pagar o mesmo custo em outro lugar, em outro trimestre, com outro nome.

O princípio que sobrevive a Klarna

Se a tese “IA come a coordenação” fosse verdadeira sem asterisco, Klarna não teria voltado atrás. Como voltou, a formulação precisa ser mais precisa.

A IA industrializa coordenação de sincronia. Status, resumo, roteamento, rascunho de roadmap. Nesses lugares, o modo de falha é limitado, a instrumentação é barata, e o ciclo de aprendizado cabe dentro de uma sprint.

A coordenação de julgamento é parcialmente automatizável e precisa de avaliação contínua. Triagem, priorização, decisões de escalada. Aqui a IA não substitui o julgamento humano. Ela propõe, resume, correlaciona, e um humano confirma dentro de uma janela de risco aceitável.

A coordenação de propriedade não se automatiza. Ela se concentra. Menos humanos carregam mais responsabilidade, com mais ferramentas agentes como alavanca. O desafio organizacional de 2026 não é “quantos gerentes cortar”. É: quem são os poucos humanos que carregam propriedade, como eles são formados, e o que acontece com o pipeline de sucessão quando a camada média fica fina.

Essa última pergunta é a que ninguém está respondendo bem. Quando o meio é removido rápido demais, mentoria e formação de próximos gerentes saem do radar. O custo não aparece em 6 meses. Aparece em 18 a 36, quando a próxima geração de proprietários deveria estar pronta e não está.

O que um programa de IA responsável parametriza

Se você está desenhando a linha dentro da sua empresa, pelo menos quatro parâmetros precisam estar explícitos:

Raio de explosão por tarefa. Para cada classe de trabalho que um agente toca, escreva em uma frase qual é o pior resultado realista. Se cabe em “parágrafo estranho no Notion”, automatize. Se cabe em “incidente com cliente” ou “multa regulatória”, mantenha propriedade humana e use o agente como copiloto, não como operador.

Camada de avaliação antes da camada de execução. Antes de ampliar o que os agentes fazem, amplie como você avalia o que eles fizeram. Métricas de saída (taxa de erro, satisfação, tempo para resolver), não só métricas de entrada (uso, minutos, chamadas).

Placar humano e agente no mesmo eixo. Não dá para medir produtividade humana por dashboards antigos e produtividade de agentes por dashboards novos. O placar precisa comparar maçãs com maçãs: a mesma tarefa, executada por humanos, agentes, ou a combinação, no mesmo eixo.

Compromisso com revisão pública. Se a tese se mostra frágil em 12 a 18 meses (Klarna, Amazon, toil subindo), a empresa precisa revisitar em público, não enterrar em silêncio. Isso é parte da maturidade operacional, não crítica.

A forma que fica

A IA está industrializando a camada de tradução da empresa. Isso é real e mensurável, e o heurístico do raio de explosão é útil. Mas industrialização não é eliminação. É redistribuição com sobra operacional nova (avaliação, on-call, switching, sucessão) que precisa ser financiada antes de ser celebrada.

A forma que sobrevive é menos simples do que manchete sugere. Menos camadas de coordenação automatizada de sincronia. Menos humanos carregando propriedade, cada um deles mais sênior e mais exposto. Uma camada nova e ainda mal nomeada no meio: engenheiros de avaliação, líderes de confiabilidade de agentes, pessoas cuja função é garantir que os agentes continuem fazendo o que disseram que fariam.

Se sua empresa está desenhando esse corte hoje, a pergunta certa não é “quantos gerentes a IA substitui”. É: sabemos onde mora a propriedade, sabemos como avaliamos os agentes que cercam ela, e temos um orçamento honesto para o trabalho novo que aparece depois?

Responder essas três perguntas em voz alta é o que separa programa de IA de narrativa de IA.

Fontes

- “What If the Robots Came for the Org Chart?” dontdos Substack (pseudônimo), abril 2026.

- “Org Design in the Age of AI.” Robonomics Substack, abril 2026.

- Wardman, Chris. “Why Bizware Is Becoming the Dominant Form of Software.” CIO.com, 2026.

- Entrepreneur. “Klarna reverses course on AI customer service.” 2025.

- Gartner. “40% of enterprise apps will feature task-specific AI agents by 2026.” Agosto 2025.

- Atlassian. “State of Teams 2025.” 2025.

- Runframe. “State of Incident Management 2026.” 2026.

A Victorino ajuda times a desenhar a linha entre coordenação segura de automatizar e propriedade que precisa ficar humana, com um placar para ambos. Fale com a gente: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa