- Início

- The Thinking Wire

- O SDK de Agentes da OpenAI Separou Harness de Compute. E a Governança?

O SDK de Agentes da OpenAI Separou Harness de Compute. E a Governança?

A OpenAI anunciou em 15 de abril de 2026 a atualização mais significativa do Agents SDK desde seu lançamento. Harness nativo com memória configurável. Orquestração sandbox-aware. Ferramentas de filesystem herdadas do Codex. Execução sandbox nativa em sete provedores: Blaxel, Cloudflare, Daytona, E2B, Modal, Runloop e Vercel.

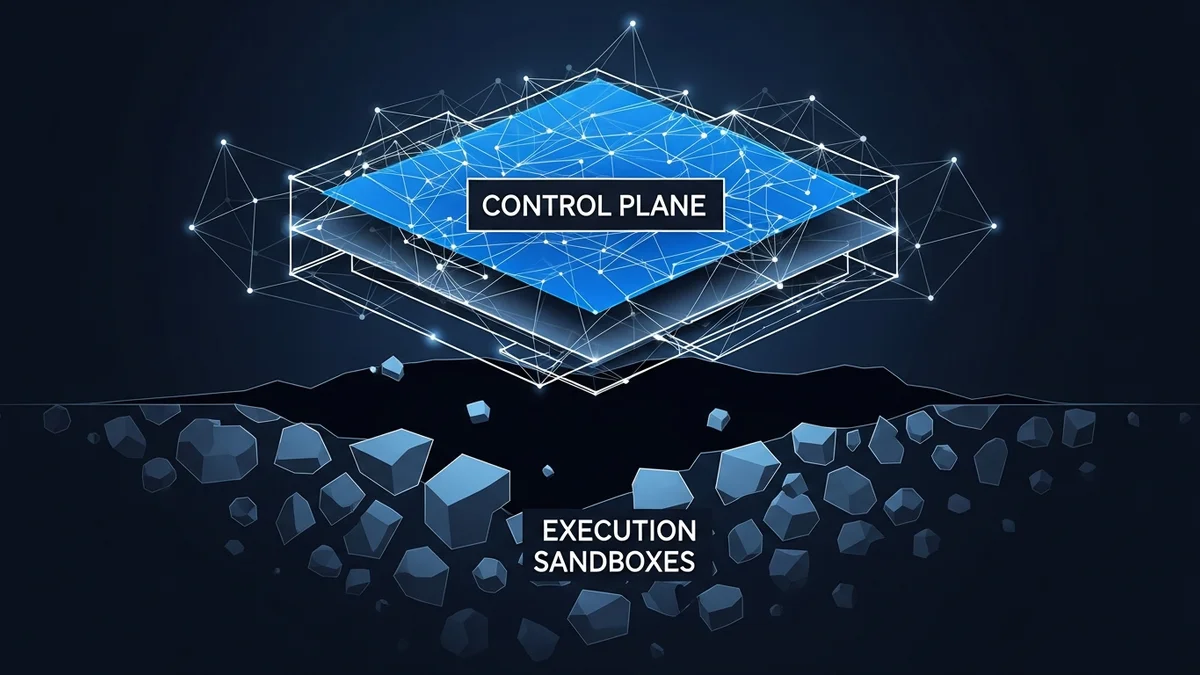

A lista de funcionalidades é longa. A decisão arquitetural que importa é uma só: separar o harness (plano de controle) do compute (ambiente de execução).

Quem acompanha infraestrutura reconhece o padrão. É o mesmo movimento que o Kubernetes fez ao separar orquestração de processamento. E, como aconteceu com o Kubernetes, a separação é sinal de que a infraestrutura de agentes está deixando a fase de experimentação e entrando na fase de padronização.

Falta uma peça. A mesma que faltava da última vez.

O que o SDK resolve

O modelo antes era monolítico. O framework definia o agente, orquestrava a execução e gerenciava o ambiente, tudo acoplado. Se você quisesse trocar o provedor de sandbox, reescrevia a integração. Se quisesse isolar credenciais, improvisava.

A nova arquitetura trata o harness como camada independente. Ele define o plano do agente (memória, ferramentas, instruções) e delega a execução para qualquer provedor compatível. Sete provedores no lançamento. Cada um com seu modelo de isolamento, precificação e latência.

O Manifest merece atenção. É uma descrição declarativa do workspace do agente: quais arquivos existem, quais ferramentas estão disponíveis, qual o estado inicial. Pense nele como um Dockerfile para agentes. É uma abstração simples que cria um pré-requisito importante: se o workspace é declarativo, ele se torna auditável.

A memória configurável é outra adição relevante. O harness agora gerencia contexto de forma nativa, com políticas explícitas de retenção e compactação. Como analisamos em Quando a Plataforma Vira Governança, a compactação da OpenAI é lossy por construção. Agora ao menos existe um ponto de configuração explícito para controlar esse comportamento.

São melhorias reais. A engenharia é competente. Mas a pergunta que determina se isso serve para produção empresarial é outra.

O que o SDK não resolve

Segurança de execução e governança são problemas diferentes.

Sandboxes isolam o ambiente. Credenciais injetadas evitam que o agente veja segredos. Allowlists controlam destinos de rede. Tudo isso é segurança de execução. O SDK endereça essa camada com competência.

Governança pergunta coisas diferentes. Quem autorizou este agente a operar? Qual política determina o que ele pode fazer com dados de clientes? Existe um log de auditoria que um regulador pode inspecionar? Se o agente tomar uma decisão errada, quem responde? Qual o limite de custo por departamento? Existe um mecanismo de aprovação escalonada para operações de alto risco?

O SDK não responde nenhuma dessas perguntas. Não pretende responder.

Isso não é uma crítica. É uma constatação de escopo. O problema é quando organizações confundem a presença de sandboxes com a presença de governança. Um agente isolado em sandbox pode exfiltrar dados para um endpoint autorizado, consumir orçamento sem limite, tomar decisões sem aprovação e operar sem identidade auditável. O sandbox garante que ele não escape do container. Não garante que ele se comporte dentro dele.

Convergência de padrões, sem convergência de controle

Uma dinâmica interessante está acontecendo em paralelo. Os padrões que permitem interoperabilidade entre agentes estão convergindo rapidamente.

O MCP (originado pela Anthropic) padroniza como agentes se conectam a ferramentas. O AGENTS.md (proposto pela OpenAI) padroniza como agentes declaram suas capacidades. O Agent Skills (também originado pela Anthropic) padroniza como capacidades são empacotadas e reutilizadas. Os três estão agora co-geridos sob a Agentic AI Foundation da Linux Foundation, com participação de AWS, Anthropic, Block, Bloomberg, Cloudflare, Google, Microsoft e OpenAI.

A adoção é concreta. Agent Skills foi adotado por mais de 35 ferramentas. AGENTS.md aparece em mais de 60 mil repositórios. O MCP se tornou o protocolo de facto para conexão agente-ferramenta.

Como argumentamos em Frameworks de Agentes São Grátis Porque Você É o Produto, o verdadeiro contest entre hyperscalers não é o SDK. É a camada acima: quem controla a governança. A convergência de padrões de interoperabilidade torna o SDK comoditizado. Qualquer provedor pode implementar MCP, ler AGENTS.md, executar Agent Skills. A diferenciação migra para quem oferece a melhor camada de controle sobre o que os agentes fazem.

Nenhum dos padrões convergentes trata de governança. MCP conecta. AGENTS.md declara. Agent Skills empacota. Nenhum audita, aprova, limita ou responsabiliza.

O que “model-native” significa (e o que não significa)

A OpenAI descreve o novo harness como “model-native.” O termo aparece repetidamente no anúncio. Merece escrutínio.

A afirmação é que modelos treinados especificamente para operar com o harness produzem resultados superiores. É plausível. É também circular sem benchmarks. “Nosso modelo funciona melhor com nosso framework” é uma afirmação que qualquer fornecedor pode fazer. A Anthropic poderia dizer o mesmo sobre Claude e o MCP. A Google poderia dizer o mesmo sobre Gemini e o ADK.

O anúncio não apresenta dados de red-team. Não quantifica a melhoria. Não compara com alternativas. As claims de segurança são arquiteturais (“o sandbox isola”), não evidenciais (“testamos N cenários e o sandbox conteve X% dos ataques”). Dado que 94,4% dos agentes LLM são vulneráveis a prompt injection segundo pesquisa recente, a ausência de evidência empírica de segurança não é um detalhe.

Code mode e subagents aparecem como “planned.” Até que existam, são promessa, não produto.

A abstração Manifest como pré-requisito de compliance

Se há uma feature silenciosa no anúncio, é o Manifest.

Uma descrição declarativa do workspace do agente (ferramentas, arquivos, estado inicial) cria algo que não existia antes: um artefato versionável e auditável que descreve o que o agente pode fazer antes de ele fazer qualquer coisa.

Isso é um pré-requisito técnico para compliance. Se você precisa demonstrar a um auditor que seu agente só tinha acesso a determinadas ferramentas e dados, o Manifest fornece a evidência. Se você precisa comparar o que foi planejado com o que foi executado, o Manifest fornece a linha de base.

Como documentamos em Especificações de Agentes Como Artefatos de Governança, declarações formais de capacidade são a base de qualquer sistema de governança auditável. O Manifest da OpenAI é um passo nessa direção. Um passo necessário, mas que só gera valor se a organização construir a camada de auditoria acima dele.

Comoditização de infraestrutura, diferenciação de controle

A decisão de suportar sete provedores de sandbox no lançamento é reveladora. Não é generosidade. É comoditização deliberada. Se o compute é intercambiável, o valor se concentra no harness. E se o harness é open source, o valor se concentra na camada que o controla.

Para organizações que estão construindo com agentes, a implicação prática é clara: não invista energia escolhendo entre E2B, Modal ou Cloudflare como se fosse uma decisão estratégica. É uma decisão de infraestrutura. Intercambiável por design. Invista energia na camada que ainda não existe no SDK: auditoria, políticas de acesso, limites operacionais, mecanismos de aprovação, identidade de agentes.

A infraestrutura que falta não é técnica. É organizacional.

O que isso significa para quem opera agentes

Para times de engenharia: a separação harness-compute é uma melhoria arquitetural real. Adotem. Mas não confundam segurança de execução com governança. Sandbox é necessário. Não é suficiente.

Para liderança técnica: o fato de que todos os hyperscalers estão convergindo em padrões de interoperabilidade (MCP, AGENTS.md, Agent Skills) sob a Linux Foundation confirma que SDKs e protocolos serão comoditizados. A vantagem competitiva está na capacidade de governar o que os agentes fazem, não na escolha de qual SDK usar para construí-los.

Para compliance e risco: o Manifest é a feature que vocês deveriam monitorar. É o primeiro artefato nativo do ecossistema de agentes que pode servir como evidência de controle. Mas ele só tem valor se integrado a um sistema de auditoria. Sozinho, é um arquivo YAML.

A OpenAI construiu a estrada. Quem constrói o departamento de trânsito somos nós.

Fontes

- OpenAI. “The next evolution of the Agents SDK.” Abril 2026.

- TechCrunch. “OpenAI updates its Agents SDK.” Abril 2026.

- Linux Foundation. “Agentic AI Foundation.” Dezembro 2025.

- Agent Skills. “Agent Skills: Open standard for reusable agent capabilities.” 2026.

- AGENTS.md. “AGENTS.md specification.” 2026.

- Model Context Protocol. “MCP specification.” 2026.

Victorino Group ajuda organizações a implementar governança de IA que funciona entre plataformas, não apenas dentro delas: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa