- Início

- The Thinking Wire

- O Loop de Atribuição Que Você Não Consegue Auditar

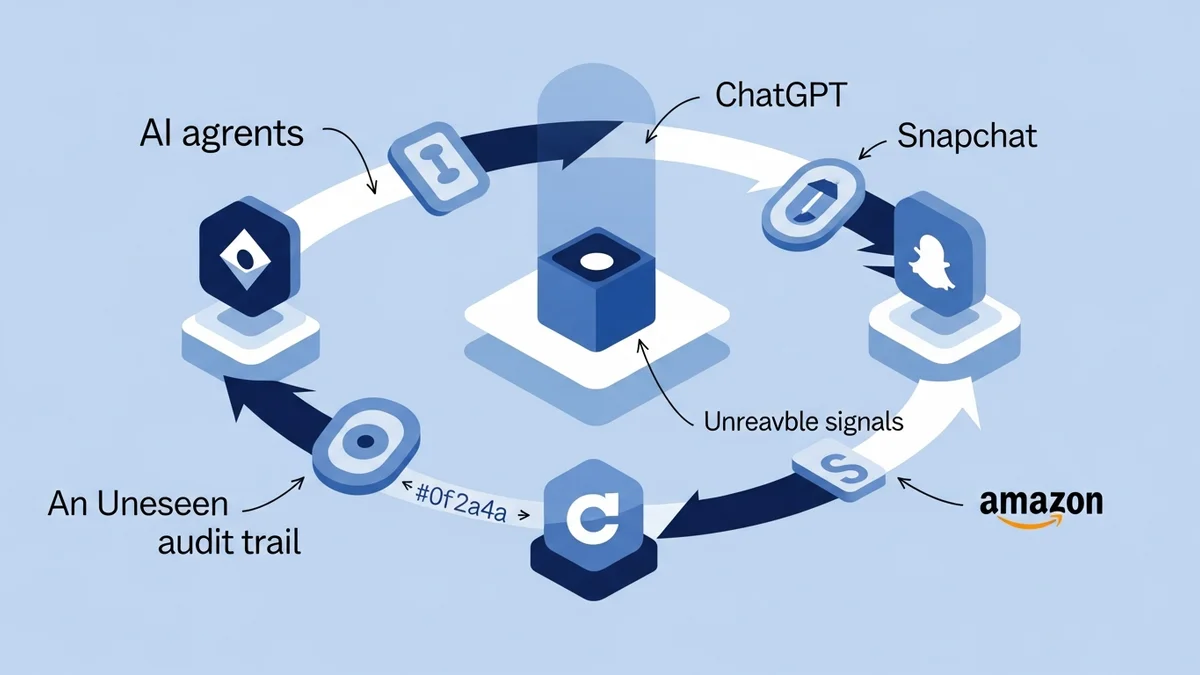

Em abril de 2026, três empresas distintas colocaram em produção infraestrutura de publicidade com IA que nenhum terceiro consegue auditar. O ChatGPT começou a transmitir unidades de anúncio patrocinadas dentro de respostas conversacionais, com a atribuição carregada por quatro tokens criptografados em Fernet, cuja chave vive apenas nos servidores da OpenAI. O Snapchat lançou os Sponsored AI Snaps — agentes de IA das marcas conversando diretamente com usuários dentro da aba Chat, a mesma superfície que carregou 950 bilhões de mensagens no último trimestre. O sistema COSMO de recomendação da Amazon foi documentado em detalhe, incluindo a parte que a maioria dos times de marketing vai pular: 65% do raciocínio bruto gerado pelo LLM teve de ser descartado para passar em uma régua interna de qualidade.

Não são três histórias. É uma história contada por três ângulos. A lacuna de auditoria dentro da infraestrutura de publicidade com IA deixou de ser previsão. É o estado de produção de hoje, e os CMOs estão herdando responsabilidade de engenharia sobre sistemas sem observabilidade de engenharia.

Já escrevemos sobre legibilidade por máquina como KPI de marketing, sobre segurança de marca na superfície legível por agentes e sobre AEO como o novo alvo de otimização. Este ensaio é o andar seguinte. Quando um agente transaciona em nome da sua marca dentro do produto de outra empresa, a pergunta não é se você consegue ser descoberto. A pergunta é se você consegue provar o que acabou de acontecer.

O Loop de Atribuição Dentro do ChatGPT

A engenharia reversa publicada pela Buchodi é a descrição mais limpa que existe em público sobre o que o loop realmente contém. Um stream de Server-Sent Events injeta um objeto JSON single_advertiser_ad_unit dentro da resposta do modelo. Um SDK separado, chamado OAIQ, roda no site do anunciante e lê um parâmetro ?oppref= da URL para um cookie first-party de 720 horas chamado __oppref. Cada chamada de medição faz POST para bzr.openai.com/v1/sdk/events. Quatro tokens criptografados em Fernet orquestram o handshake: ads_spam_integrity_payload para integridade no servidor, oppref para atribuição direta, olref para rastreio de link de saída e ad_data_token como envelope de atribuição base64 envolvido em Fernet.

Uma única conta de teste recebeu seis anunciantes diferentes em seis conversas sobre seis temas distintos. Pesquisa sobre viagem a Pequim acabou no Grubhub. Pergunta sobre NBA acabou na Gametime. O cabeçalho Fernet revela timestamps de geração; um clique registrou 95 segundos de latência entre geração e uso.

Leia o loop com calma e um fato fica inescapável: cada sinal que o time de marketing da marca precisaria para verificar gasto, audiência, contexto de segurança de marca ou até posição do anúncio está cifrado com uma chave que a marca jamais terá. A marca enxerga aquilo que a OpenAI conta. Não há camada de medição independente. Não há superfície de consentimento documentada para o usuário. Não há regulador lendo o mesmo envelope. O produto entrou no ar antes de existir um padrão de auditoria, o que significa que o padrão, quando chegar, será adaptado em cima de um sistema cujo modelo de integridade nunca foi desenhado para inspeção externa.

Essa é a inversão que importa. Em todo canal de publicidade anterior — TV, rádio, display, social — o andaime de medição entrou junto com o inventário. Imperfeito, manipulável, mas externo. A geração atual entra com o andaime de medição inteiramente dominado pela plataforma. O CMO está sendo convidado a aprovar um orçamento contra um modelo de atribuição cuja fonte da verdade ele não consegue ler.

Snapchat: Agentes de Marca Dentro da Conversa

Os Sponsored AI Snaps movem a superfície de novo. A fronteira anterior era posicionamento pago em torno da conversa. A fronteira atual é participação paga dentro dela. As marcas agora colocam seus próprios agentes de IA na aba de Chat. O usuário pergunta para o agente da marca e recebe uma recomendação de produto na mesma thread em que conversa com amigos.

Os números de performance, conforme reportados pelo próprio Snap, são a parte que deveria tirar o sono de qualquer líder de operações de marketing: 22% mais conversões e custo por ação 20% menor em relação aos Sponsored Snaps tradicionais. 85% dos usuários do Snap interagem com a aba Chat regularmente. O primeiro trimestre de 2026 fechou com 950 bilhões de mensagens. O chatbot geral de IA do Snap, lançado em 2023, já recebeu mensagens de mais de 500 milhões de usuários.

Encare o formato com honestidade. O agente de uma marca passa a ser participante de uma conversa privada. Cada saída desse agente é um ato editorial, feito na velocidade e no volume de uma frota de servidores, com impacto de marca equivalente a tudo o que um porta-voz humano poderia dizer em público. O prompt do agente, suas fontes de recuperação, seus filtros de segurança e sua cadência de atualização são artefatos de governança. Nenhum deles passa pelo mesmo pipeline de aprovação que um comercial de TV. A maioria dos times de marketing nem possui o fluxo que os faria passar.

A lacuna de auditoria aqui não é tokens criptografados. É organizacional. O agente é um canal de saída editorial, mas o time que aprova copy, o time que aprova jurídico e o time que aprova prompts costumam ser três times diferentes que nunca sentaram na mesma sala.

Amazon COSMO: A Disciplina de Qualidade Que Marketing Não Tem

O terceiro ângulo expõe quão imatura é a relação da maioria dos times com a saída de IA que eles próprios produzem. O COSMO da Amazon é um grafo de conhecimento que usa LLMs para gerar conexões de senso comum por trás de recomendações de produto — por exemplo, que uma usuária grávida procurando sapatos provavelmente quer modelos antiderrapantes. O ganho em produção, em testes A/B, é de 0,7% de aumento de vendas e 8% de aumento de engajamento de navegação, em cerca de 10% do tráfego americano. Pelo padrão Amazon, é uma vitória real.

O que recebe menos atenção é a estrutura de custo por trás dessa vitória. Da saída bruta do LLM, 35% das explicações de busca-compra e 9% das explicações de co-compra passam na régua de qualidade da Amazon. O resto — a maioria — é descartado. A Amazon não confia no modelo. Ela passa a saída por um filtro baseado em regras, depois por uma deduplicação por similaridade vetorial, depois por 30 mil anotações humanas em cinco perguntas de sim-ou-não, depois por um classificador DeBERTa fine-tunado com limiar de plausibilidade de 0,5. Só o que sobrevive entra no índice. Essas 30 mil anotações sementearam um grafo de 6,3 milhões de nós e 29 milhões de arestas — uma alavancagem de aproximadamente mil para um entre supervisão humana e saída de máquina.

Há ainda um detalhe para o qual vale parar. A Amazon usou o modelo OPT da Meta, não o GPT-4. Por quê? Porque dados de comportamento de cliente precisavam ficar dentro de casa. Privacidade de dados foi restrição de arquitetura, não política colada depois. A escolha do modelo foi consequência da escolha de governança.

Agora inverta a lente para uma organização de marketing que produz copy gerada por IA, insights de audiência gerados por IA, prompts de agente gerados por IA. Onde está o filtro baseado em regras? Onde está a deduplicação? Onde estão os 30 mil exemplos anotados que treinam um classificador específico da marca sobre o que é, de fato, o seu tom de voz? Onde está o limiar a partir do qual uma saída do agente pode encarar um cliente? Para a maioria dos times, a resposta honesta é: em lugar nenhum. A saída do modelo chega à superfície sem filtro, e a única auditoria é a que um chamado de atendimento dispara depois.

O Que o CMO Está Sendo Convidado a Assinar

Coloque as três observações lado a lado e a realidade operacional fica nítida. O loop de atribuição do ChatGPT é, por desenho, não auditável. O formato de agente de marca do Snapchat coloca saída editorial dentro de uma conversa privada sem pipeline paralelo de governança. A Amazon mostra a disciplina necessária para usar saída de LLM em produção, e essa disciplina está, na maior parte, ausente em marketing.

A pergunta para qualquer líder de marketing que vai gastar nesses canais nos próximos dois trimestres não é se participa. A pergunta é qual evidência você terá em mãos quando algo der errado, quem vai ler essa evidência e se o formato que você assinou alguma vez produziu alguma.

Faça Isto Agora

Antes do próximo briefing de campanha, escreva as respostas a quatro perguntas. Cada uma leva noventa minutos com as pessoas certas na sala.

Integridade dos tokens. Para cada superfície de anúncio mediada por IA em que você for gastar este trimestre, liste os sinais que você recebe no momento da atribuição. Marque cada um como atestado pela plataforma, verificado por terceiro ou criptografado-mas-confiável. Se a coluna de “verificado por terceiro” estiver vazia, você está gastando contra fonte única da verdade.

Governança conversacional. Se você lançou ou está prestes a lançar um agente de IA dentro da superfície de conversa de uma plataforma terceira (Snapchat, ChatGPT, Meta, outras), liste os prompts, as fontes de recuperação, os filtros de segurança e a cadência de atualização. Compare essa lista com o pipeline editorial pelo qual passa um comercial de TV ou uma peça de display. O delta é o seu débito de governança.

Régua de qualidade da saída. Para a saída de marketing gerada por IA pela sua própria equipe — copy, prompts, segmentação de audiência — anote a taxa de descarte. Se você não tem uma, a taxa é zero, e você está publicando o primeiro rascunho do modelo. Escolha uma classe de saída e construa um filtro baseado em regras para ela ainda este mês.

Privacidade como arquitetura. A Amazon escolheu OPT em vez de GPT-4 por causa de onde os dados do cliente podiam, legalmente, ficar. A pergunta equivalente para você é: onde estão os dados de comportamento do seu cliente quando a IA gera saída em cima deles? Se a resposta coloca um regulador na sala, a escolha de arquitetura é anterior a toda decisão do agente.

Os times de marketing que vão sobreviver aos próximos dois anos de infraestrutura de publicidade com IA não são os que têm mais agentes em mais canais. São aqueles cujos agentes deixam evidência que o time consegue ler, cujas conversas deixam transcrição que o time consegue auditar e cuja saída de modelo passa por um limiar de descarte que o time consegue defender. A lacuna de auditoria não fecha sozinha. As plataformas já entregaram. O padrão, ainda não.

Fontes

- How ChatGPT Serves Ads — Here’s the Full Attribution Loop — Buchodi, abril de 2026.

- Snapchat Brings AI-Powered Conversational Advertising to Its App — TechCrunch, abril de 2026.

- How Amazon Uses LLMs to Recommend Products — ByteByteGo, abril de 2026.

A Victorino ajuda líderes de marketing e engenharia a desenhar infraestrutura de auditoria e verificação para agentes de IA que transacionam em nome da marca: contato@victorino.com.br | www.victorino.com.br

Todos os artigos do The Thinking Wire são escritos com o auxílio do modelo LLM Opus da Anthropic. Cada publicação passa por pesquisa multi-agente para verificar fatos e identificar contradições, seguida de revisão e aprovação humana antes da publicação. Se você encontrar alguma informação imprecisa ou deseja entrar em contato com o editorial, escreva para editorial@victorino.com.br . Sobre o The Thinking Wire →

Se isso faz sentido, vamos conversar

Ajudamos empresas a implementar IA sem perder o controle.

Agendar uma Conversa